注意

转到底部 下载完整的示例代码。

TorchRL 教程:多智能体强化学习 (PPO)¶

作者: Matteo Bettini

另请参阅

BenchMARL 库提供了使用 TorchRL 的最先进的 MARL 算法实现。

本教程演示了如何使用 PyTorch 和 torchrl 来解决多智能体强化学习 (MARL) 问题。

为了方便使用,本教程将遵循现有教程的一般结构:TorchRL 强化学习 (PPO) 教程。建议在开始本教程之前熟悉该教程,但并非强制要求。

在本教程中,我们将使用 VMAS 中的“导航”环境,这是一个多机器人模拟器,同样基于 PyTorch,它在设备上运行并行批处理模拟。

在“导航”环境中,我们需要训练多个机器人(在随机位置生成)导航到它们的目标(也在随机位置),同时使用 LIDAR 传感器来避免相互碰撞。

多智能体“导航”场景¶

主要学习内容

如何在 TorchRL 中创建多智能体环境,它的规范如何工作,以及它如何与库集成;

如何在 TorchRL 中使用 GPU 矢量化环境;

如何在 TorchRL 中创建不同的多智能体网络架构(例如,使用参数共享、集中式评论员)

我们如何使用

tensordict.TensorDict来承载多智能体数据;如何将所有库组件(收集器、模块、回放缓冲区和损失)整合到多智能体 MAPPO/IPPO 训练循环中。

如果您在 Google Colab 中运行此代码,请确保安装以下依赖项

!pip3 install torchrl

!pip3 install vmas

!pip3 install tqdm

近端策略优化(PPO)是一种策略梯度算法,它收集并直接消耗一批数据,以在存在某些近端约束的情况下最大化预期回报来训练策略。您可以将其视为 REINFORCE(基础策略优化算法)的复杂版本。有关更多信息,请参阅 近端策略优化算法论文。

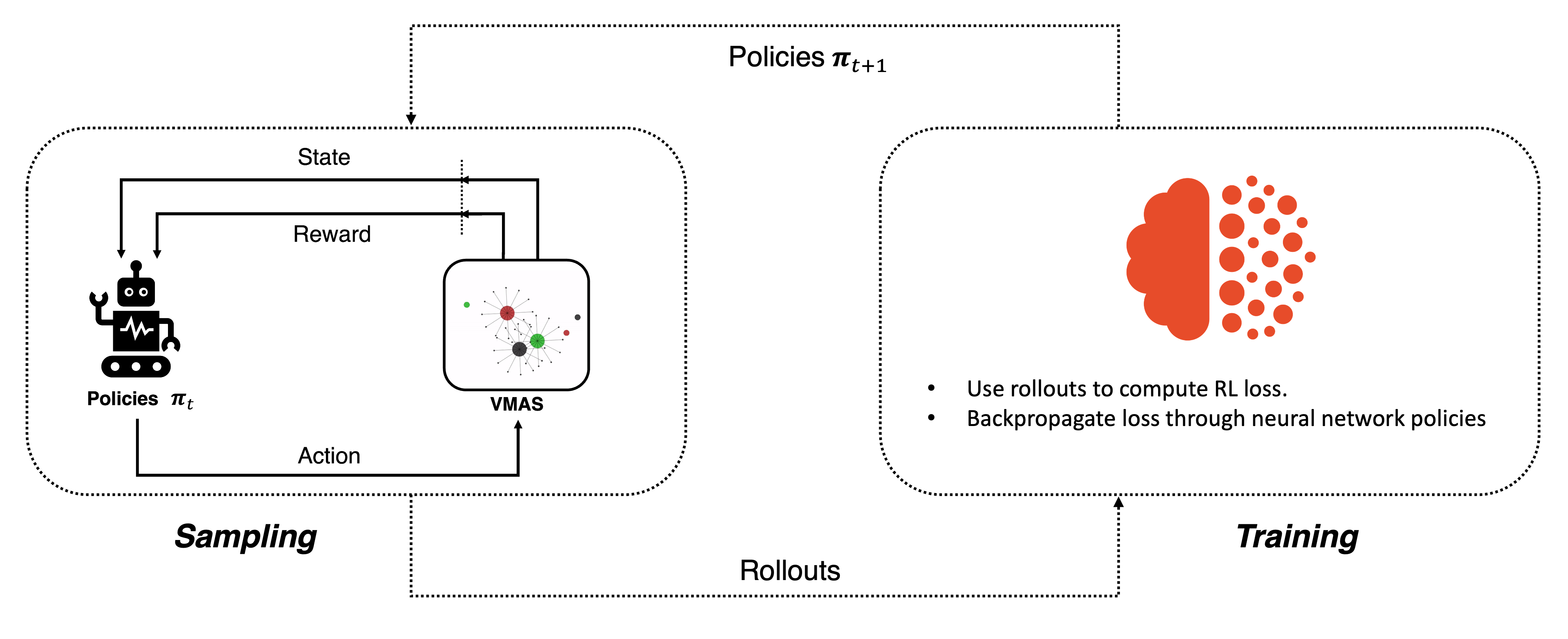

这类算法通常是“*在策略上*”训练的。这意味着在每次学习迭代中,我们都有一个**采样**和一个**训练**阶段。在迭代 \(t\) 的**采样**阶段,使用当前策略 \(\mathbf{\pi}_t\) 从智能体与环境的交互中收集的轨迹。在**训练**阶段,所有收集到的轨迹会立即馈送到训练过程以执行反向传播。这会导致策略更新,然后再次用于采样。该过程的循环执行构成了“*在策略上学习*”。

在策略上学习¶

在 PPO 算法的训练阶段,会使用一个*评论员*来估计策略所采取行动的好坏。评论员学习近似特定状态的价值(折扣回报的平均值)。然后,PPO 损失将策略获得的实际回报与评论员估计的回报进行比较,以确定所采取行动的优势,并指导策略优化。

在多智能体环境中,情况有所不同。我们现在有多个策略 \(\mathbf{\pi}\),每个智能体一个。策略通常是局部的和分散的。这意味着单个智能体的策略将仅基于其观察值输出该智能体的行动。在 MARL 文献中,这被称为**分散式执行**。另一方面,评论员存在不同的表述,主要有:

在 MAPPO 中,评论员是集中的,并且将系统的全局状态作为输入。这可以是全局观察,或者是智能体观察的简单拼接。MAPPO 可用于执行**集中式训练**的场景,因为它需要访问全局信息。

在 IPPO 中,评论员只接收相应智能体的观察作为输入,这与策略完全相同。这允许**分散式训练**,因为评论员和策略都只需要本地信息来计算它们的输出。

集中式评论员有助于克服多个智能体同时学习时的非平稳性,但另一方面,它们可能会受到其巨大输入空间的影响。在本教程中,我们将能够训练这两种表述,我们还将讨论参数共享(跨智能体共享网络参数的做法)如何影响每一种。

本教程结构如下

首先,我们将定义一组将要使用的超参数。

接下来,我们将创建一个矢量化多智能体环境,使用 TorchRL 对 VMAS 模拟器的包装器。

接下来,我们将设计策略和评论员网络,讨论各种选择对参数共享和评论员中心化的影响。

接下来,我们将创建采样收集器和回放缓冲区。

最后,我们将运行训练循环并分析结果。

如果您在 Colab 或带有 GUI 的机器上运行此程序,您还可以选择在训练您的策略之前和之后渲染和可视化它。

让我们导入我们的依赖项

# Torch

import torch

# Tensordict modules

from tensordict.nn import set_composite_lp_aggregate, TensorDictModule

from tensordict.nn.distributions import NormalParamExtractor

from torch import multiprocessing

# Data collection

from torchrl.collectors import SyncDataCollector

from torchrl.data.replay_buffers import ReplayBuffer

from torchrl.data.replay_buffers.samplers import SamplerWithoutReplacement

from torchrl.data.replay_buffers.storages import LazyTensorStorage

# Env

from torchrl.envs import RewardSum, TransformedEnv

from torchrl.envs.libs.vmas import VmasEnv

from torchrl.envs.utils import check_env_specs

# Multi-agent network

from torchrl.modules import MultiAgentMLP, ProbabilisticActor, TanhNormal

# Loss

from torchrl.objectives import ClipPPOLoss, ValueEstimators

# Utils

torch.manual_seed(0)

from matplotlib import pyplot as plt

from tqdm import tqdm

定义超参数¶

我们设置本教程的超参数。根据可用资源,可以选择在 GPU 或其他设备上执行策略和模拟器。您可以调整其中一些值来调整计算需求。

# Devices

is_fork = multiprocessing.get_start_method() == "fork"

device = (

torch.device(0)

if torch.cuda.is_available() and not is_fork

else torch.device("cpu")

)

vmas_device = device # The device where the simulator is run (VMAS can run on GPU)

# Sampling

frames_per_batch = 6_000 # Number of team frames collected per training iteration

n_iters = 5 # Number of sampling and training iterations

total_frames = frames_per_batch * n_iters

# Training

num_epochs = 30 # Number of optimization steps per training iteration

minibatch_size = 400 # Size of the mini-batches in each optimization step

lr = 3e-4 # Learning rate

max_grad_norm = 1.0 # Maximum norm for the gradients

# PPO

clip_epsilon = 0.2 # clip value for PPO loss

gamma = 0.99 # discount factor

lmbda = 0.9 # lambda for generalised advantage estimation

entropy_eps = 1e-4 # coefficient of the entropy term in the PPO loss

# disable log-prob aggregation

set_composite_lp_aggregate(False).set()

环境¶

多智能体环境模拟多个智能体与世界互动。TorchRL API 允许集成各种类型多智能体环境。一些例子包括具有共享或个体奖励、完成标志和观察的环境。有关 TorchRL 中多智能体环境 API 如何工作的更多信息,您可以查看专门的文档部分。

VMAS 模拟器尤其如此,它使用个体奖励、信息、观察和动作来模拟智能体,但有一个集体完成标志。此外,它使用*矢量化*来在批次中执行模拟。这意味着其所有状态和物理都是 PyTorch 张量,第一维表示批次中的并行环境数量。这允许利用 GPU 的单指令多数据 (SIMD) 范例,并通过利用 GPU warp 中的并行化来显着加快并行计算速度。这也意味着,在 TorchRL 中使用它时,模拟和训练都可以**在设备上**运行,而无需将数据传递到 CPU。

我们今天将要解决的多智能体任务是“导航”(见上面的动画图)。在“导航”任务中,随机生成的智能体(带有点的圆圈)需要导航到随机生成的(较小的)目标圆圈。智能体需要使用 LIDAR(周围的点)来避免相互碰撞。智能体在一个具有拖拽和弹性碰撞的 2D 连续世界中行动。它们的行动是 2D 连续力,决定了它们的加速度。奖励由三部分组成:碰撞惩罚、基于到目标距离的奖励,以及当所有智能体都到达目标时给出的最终共享奖励。基于距离的部分计算为智能体与其目标在两个连续时间步之间的相对距离之差。每个智能体观察其位置、速度、LIDAR 读数以及到其目标的相对位置。

我们将实例化环境。在本教程中,我们将把**剧集限制为** max_steps,之后将设置完成标志。这是 VMAS 模拟器已经提供的功能,但 TorchRL 的 StepCount 转换也可以使用。我们还将使用 num_vmas_envs 个矢量化环境,以利用批处理模拟。

max_steps = 100 # Episode steps before done

num_vmas_envs = (

frames_per_batch // max_steps

) # Number of vectorized envs. frames_per_batch should be divisible by this number

scenario_name = "navigation"

n_agents = 3

env = VmasEnv(

scenario=scenario_name,

num_envs=num_vmas_envs,

continuous_actions=True, # VMAS supports both continuous and discrete actions

max_steps=max_steps,

device=vmas_device,

# Scenario kwargs

n_agents=n_agents, # These are custom kwargs that change for each VMAS scenario, see the VMAS repo to know more.

)

环境不仅由其模拟器和转换定义,还由一系列描述其执行过程中可预期内容的元数据定义。为了效率起见,TorchRL 在环境规范方面非常严格,但您可以轻松检查您的环境规范是否合适。在我们的示例中,VmasEnv 负责为您的环境设置正确的规范,因此您不必担心这个问题。

有四个规范需要关注

action_spec定义了动作空间;reward_spec定义了奖励域;done_spec定义了完成域;observation_spec定义了环境步骤所有其他输出的域;

print("action_spec:", env.full_action_spec)

print("reward_spec:", env.full_reward_spec)

print("done_spec:", env.full_done_spec)

print("observation_spec:", env.observation_spec)

使用上面显示的命令,我们可以访问每个值的域。这样做,我们可以看到除了完成之外的所有规范都带有前导形状 (num_vmas_envs, n_agents)。这代表了每个环境中每个智能体都会存在这些值。另一方面,完成规范带有前导形状 num_vmas_envs,代表完成是在智能体之间共享的。

TorchRL 有一种方法可以跟踪哪些 MARL 规范是共享的,哪些不是。实际上,具有附加智能体维度(即,它们对每个智能体都不同)的规范将包含在一个内部“agents”键中。

正如你所见,奖励和动作规范呈现了“agent”键,这意味着属于这些规范的 tensordicts 中的条目将嵌套在一个“agents” tensordict 中,将所有每个智能体的值分组。

要快速访问 tensordicts 中每个值的键,我们可以简单地向环境询问相应的键,我们就会立即了解哪些是每个智能体的值,哪些是共享的。此信息将有助于我们告诉所有其他 TorchRL 组件在哪里找到每个值

print("action_keys:", env.action_keys)

print("reward_keys:", env.reward_keys)

print("done_keys:", env.done_keys)

变换 (Transforms)¶

我们可以附加任何我们需要的 TorchRL 转换到我们的环境中。这些转换将以某种期望的方式修改其输入/输出。我们强调,在多智能体上下文中,显式提供要修改的键是至关重要的。

例如,在这种情况下,我们将实例化一个 RewardSum 转换,它将对整个剧集的奖励求和。我们将告诉此转换在哪里找到奖励键以及在哪里写入求和的剧集奖励。转换后的环境将继承包装环境的设备和元数据,并根据其包含的转换序列来转换它们。

env = TransformedEnv(

env,

RewardSum(in_keys=[env.reward_key], out_keys=[("agents", "episode_reward")]),

)

该 check_env_specs() 函数运行一个小的回滚,并将其输出与环境规范进行比较。如果没有引发错误,我们可以确信规范已正确定义。

check_env_specs(env)

回滚 (Rollout)¶

为了好玩,让我们看看一个简单的随机回滚是什么样的。您可以调用 env.rollout(n_steps) 并获得环境输入和输出外观的概览。动作将自动从动作规范域中随机抽取。

n_rollout_steps = 5

rollout = env.rollout(n_rollout_steps)

print("rollout of three steps:", rollout)

print("Shape of the rollout TensorDict:", rollout.batch_size)

我们可以看到我们的回滚具有 batch_size 为 (num_vmas_envs, n_rollout_steps)。这意味着其中所有张量都将具有这些前导维度。

更深入地看,我们可以看到输出 tensordict 可以这样划分

在根目录(可通过运行

rollout.exclude("next")访问)我们将找到在第一次调用 reset 后可用的所有键。我们可以通过索引n_rollout_steps维度来查看它们在回滚步骤中的演变。在这些键中,我们将找到在rollout["agents"]tensordict 中每个智能体都不同的键,它将具有(num_vmas_envs, n_rollout_steps, n_agents)的批处理大小,表示它存储了附加的智能体维度。在此智能体 tensordict 之外的那些将是共享的(在本例中只有完成)。在 next(可通过运行

rollout.get("next")访问)。我们将找到与根目录相同的结构,但对于仅在步骤后可用的键。

在 TorchRL 中,惯例是 done 和 observations 会同时出现在根目录和 next 中(因为它们在重置时间和步骤之后都可用)。Action 只在根目录中可用(因为步骤没有动作),Reward 只在 next 中可用(因为重置时间没有奖励)。此结构遵循**强化学习:导论(Sutton 和 Barto)**中的结构,其中根目录表示时间 \(t\) 的数据,next 表示世界步骤时间 \(t+1\) 的数据。

渲染随机回滚¶

如果您正在 Google Colab 或具有 OpenGL 和 GUI 的机器上运行,您实际上可以渲染一个随机回滚。这将让您大致了解随机策略在此任务中将实现的目标,以便与您自己训练的策略进行比较!

要渲染回滚,请遵循本教程末尾“渲染”部分中的说明,只需从 env.rollout() 中删除 policy=policy 行即可。

策略 (Policy)¶

PPO 利用随机策略来处理探索。这意味着我们的神经网络将不得不输出分布的参数,而不是对应于所采取行动的单个值。

由于数据是连续的,我们使用 Tanh-Normal 分布来遵守动作空间边界。TorchRL 提供了这种分布,我们唯一需要关心的是构建一个输出正确数量参数的神经网络。

在这种情况下,每个智能体的动作将由一个 2 维独立正态分布表示。为此,我们的神经网络将需要为每个动作输出一个均值和一个标准差。因此,每个智能体将有 2 * n_actions_per_agents 个输出。

我们需要做出的另一个重要决定是是否希望我们的智能体**共享策略参数**。一方面,共享参数意味着它们将共享相同的策略,这将使它们能够从彼此的经验中受益。这还将导致更快的训练。另一方面,它将使它们在行为上“*同质化*”,因为它们实际上将共享相同的模型。在此示例中,我们将启用共享,因为我们不介意同质化并且可以从计算速度中受益,但在您自己的问题中,始终考虑此决定非常重要!

我们分三个步骤设计策略。

第一步:定义一个神经网络 n_obs_per_agent -> 2 * n_actions_per_agents

为此,我们使用 MultiAgentMLP,这是一个专门为多个智能体设计的 TorchRL 模块,具有许多可定制的选项。

share_parameters_policy = True

policy_net = torch.nn.Sequential(

MultiAgentMLP(

n_agent_inputs=env.observation_spec["agents", "observation"].shape[

-1

], # n_obs_per_agent

n_agent_outputs=2

* env.full_action_spec[env.action_key].shape[-1], # 2 * n_actions_per_agents

n_agents=env.n_agents,

centralised=False, # the policies are decentralised (ie each agent will act from its observation)

share_params=share_parameters_policy,

device=device,

depth=2,

num_cells=256,

activation_class=torch.nn.Tanh,

),

NormalParamExtractor(), # this will just separate the last dimension into two outputs: a loc and a non-negative scale

)

第二步:将神经网络包装在 TensorDictModule 中

这只是一个模块,它将从 tensordict 中读取 in_keys,将它们馈送到神经网络,并将输出原地写入 out_keys。

请注意,我们使用 ("agents", ...) 键,因为这些键表示带有附加 n_agents 维度的数据。

policy_module = TensorDictModule(

policy_net,

in_keys=[("agents", "observation")],

out_keys=[("agents", "loc"), ("agents", "scale")],

)

第三步:将 TensorDictModule 包装在 ProbabilisticActor 中

现在我们需要从正态分布的均值和标准差构建一个分布。为此,我们指示 ProbabilisticActor 类从均值和标准差参数构建一个 TanhNormal。我们还提供了此分布的最小值和最大值,我们从环境规范中获取这些值。

in_keys 的名称(因此也是上面 TensorDictModule 的 out_keys 的名称)必须以 TanhNormal 分布构造函数的关键字参数(loc 和 scale)结尾。

policy = ProbabilisticActor(

module=policy_module,

spec=env.action_spec_unbatched,

in_keys=[("agents", "loc"), ("agents", "scale")],

out_keys=[env.action_key],

distribution_class=TanhNormal,

distribution_kwargs={

"low": env.full_action_spec_unbatched[env.action_key].space.low,

"high": env.full_action_spec_unbatched[env.action_key].space.high,

},

return_log_prob=True,

) # we'll need the log-prob for the PPO loss

评论员网络¶

评论员网络是 PPO 算法的一个关键组成部分,尽管它在采样时并不使用。此模块将读取观察值并返回相应的价值估计。

与之前一样,人们应该仔细考虑**共享评论员参数**的决定。一般来说,参数共享将带来更快的训练收敛速度,但有几个重要考虑因素:

不建议在智能体具有不同奖励函数时共享,因为评论员需要学习为同一状态分配不同的值(例如,在混合合作-竞争场景中)。

在分散式训练设置中,在没有额外基础设施来同步参数的情况下无法进行共享。

在所有其他情况下,当所有智能体的奖励函数(与奖励不同)相同时(如当前场景),共享可以提供改进的性能。这可能会以智能体策略同质化的代价为代价。一般来说,了解哪种选择更优的最佳方法是快速尝试这两种选项。

这里也是我们必须在**MAPPO 和 IPPO**之间进行选择的地方

使用 MAPPO,我们将获得一个具有完全可观测性的集中式评论员(即,它将以所有智能体观察值的拼接作为输入)。由于我们处于模拟器中且训练是集中的,因此我们可以这样做。

使用 IPPO,我们将拥有一个局部的分散式评论员,就像策略一样。

无论哪种情况,评论员输出的形状都将是 (..., n_agents, 1)。如果评论员是集中的并且是共享的,那么 n_agents 维度的所有值都将是相同的。

share_parameters_critic = True

mappo = True # IPPO if False

critic_net = MultiAgentMLP(

n_agent_inputs=env.observation_spec["agents", "observation"].shape[-1],

n_agent_outputs=1, # 1 value per agent

n_agents=env.n_agents,

centralised=mappo,

share_params=share_parameters_critic,

device=device,

depth=2,

num_cells=256,

activation_class=torch.nn.Tanh,

)

critic = TensorDictModule(

module=critic_net,

in_keys=[("agents", "observation")],

out_keys=[("agents", "state_value")],

)

让我们试试我们的策略和评论员模块。如前所述,使用 TensorDictModule 可以直接读取环境的输出来运行这些模块,因为它们知道要读取哪些信息以及在哪里写入它们

从这一点开始,多智能体特定的组件已经实例化,我们将简单地使用与单智能体学习相同的组件。这不是很棒吗?

print("Running policy:", policy(env.reset()))

print("Running value:", critic(env.reset()))

数据收集器 (Data collector)¶

TorchRL 提供了一组数据收集器类。简而言之,这些类执行三个操作:重置环境、使用策略和最新观察值计算动作、在环境中执行一步,并重复最后两个步骤,直到环境发出停止信号(或达到完成状态)。

我们将使用最简单的数据收集器,它具有与环境回滚相同的输出,唯一的区别是它将自动重置完成状态,直到收集到所需的帧数。

collector = SyncDataCollector(

env,

policy,

device=vmas_device,

storing_device=device,

frames_per_batch=frames_per_batch,

total_frames=total_frames,

)

回放缓冲区 (Replay buffer)¶

回放缓冲区是离策略 RL 算法的常见构建模块。在策略环境中,每当收集一批数据时,回放缓冲区就会被重新填充,并且其数据会在一定数量的 epoch 中被重复消耗。

为 PPO 使用回放缓冲区并非强制要求,我们可以简单地在线使用收集到的数据,但使用这些类可以让我们轻松地以可重现的方式构建内部训练循环。

replay_buffer = ReplayBuffer(

storage=LazyTensorStorage(

frames_per_batch, device=device

), # We store the frames_per_batch collected at each iteration

sampler=SamplerWithoutReplacement(),

batch_size=minibatch_size, # We will sample minibatches of this size

)

损失函数 (Loss function)¶

PPO 损失可以直接从 TorchRL 导入,以便于使用 ClipPPOLoss 类。这是利用 PPO 最简单的方法:它隐藏了 PPO 的数学运算以及与之相关的控制流。

PPO 需要一些“优势估计”来计算。简而言之,优势是一个反映回报值期望的(在处理偏差/方差权衡时)。要计算优势,只需(1)构建优势模块,它利用我们的价值运算符,以及(2)在每个 epoch 之前将每个数据批次通过它。GAE 模块将使用新的 "advantage" 和 "value_target" 条目更新输入 TensorDict。“value_target”是一个无梯度张量,表示价值网络应表示的带有输入观察值的经验值。这两者都将由 ClipPPOLoss 用来返回策略和价值损失。

loss_module = ClipPPOLoss(

actor_network=policy,

critic_network=critic,

clip_epsilon=clip_epsilon,

entropy_coef=entropy_eps,

normalize_advantage=False, # Important to avoid normalizing across the agent dimension

)

loss_module.set_keys( # We have to tell the loss where to find the keys

reward=env.reward_key,

action=env.action_key,

value=("agents", "state_value"),

# These last 2 keys will be expanded to match the reward shape

done=("agents", "done"),

terminated=("agents", "terminated"),

)

loss_module.make_value_estimator(

ValueEstimators.GAE, gamma=gamma, lmbda=lmbda

) # We build GAE

GAE = loss_module.value_estimator

optim = torch.optim.Adam(loss_module.parameters(), lr)

训练循环¶

现在我们有了编写训练循环所需的所有组件。步骤包括

- 收集数据

- 计算优势

- 遍历 epoch

- 遍历 minibatch 来计算损失值

反向传播

优化

重复

重复

重复

重复

pbar = tqdm(total=n_iters, desc="episode_reward_mean = 0")

episode_reward_mean_list = []

for tensordict_data in collector:

tensordict_data.set(

("next", "agents", "done"),

tensordict_data.get(("next", "done"))

.unsqueeze(-1)

.expand(tensordict_data.get_item_shape(("next", env.reward_key))),

)

tensordict_data.set(

("next", "agents", "terminated"),

tensordict_data.get(("next", "terminated"))

.unsqueeze(-1)

.expand(tensordict_data.get_item_shape(("next", env.reward_key))),

)

# We need to expand the done and terminated to match the reward shape (this is expected by the value estimator)

with torch.no_grad():

GAE(

tensordict_data,

params=loss_module.critic_network_params,

target_params=loss_module.target_critic_network_params,

) # Compute GAE and add it to the data

data_view = tensordict_data.reshape(-1) # Flatten the batch size to shuffle data

replay_buffer.extend(data_view)

for _ in range(num_epochs):

for _ in range(frames_per_batch // minibatch_size):

subdata = replay_buffer.sample()

loss_vals = loss_module(subdata)

loss_value = (

loss_vals["loss_objective"]

+ loss_vals["loss_critic"]

+ loss_vals["loss_entropy"]

)

loss_value.backward()

torch.nn.utils.clip_grad_norm_(

loss_module.parameters(), max_grad_norm

) # Optional

optim.step()

optim.zero_grad()

collector.update_policy_weights_()

# Logging

done = tensordict_data.get(("next", "agents", "done"))

episode_reward_mean = (

tensordict_data.get(("next", "agents", "episode_reward"))[done].mean().item()

)

episode_reward_mean_list.append(episode_reward_mean)

pbar.set_description(f"episode_reward_mean = {episode_reward_mean}", refresh=False)

pbar.update()

结果 (Results)¶

让我们绘制每集获得的平均奖励

为了让训练持续更长时间,请增加 n_iters 超参数。

plt.plot(episode_reward_mean_list)

plt.xlabel("Training iterations")

plt.ylabel("Reward")

plt.title("Episode reward mean")

plt.show()

渲染¶

如果您在带有 GUI 的机器上运行此程序,您可以通过运行以下命令来渲染训练好的策略:

with torch.no_grad():

env.rollout(

max_steps=max_steps,

policy=policy,

callback=lambda env, _: env.render(),

auto_cast_to_device=True,

break_when_any_done=False,

)

如果您正在 Google Colab 上运行此程序,您可以通过运行以下命令来渲染训练好的策略:

!apt-get update

!apt-get install -y x11-utils

!apt-get install -y xvfb

!pip install pyvirtualdisplay

import pyvirtualdisplay

display = pyvirtualdisplay.Display(visible=False, size=(1400, 900))

display.start()

from PIL import Image

def rendering_callback(env, td):

env.frames.append(Image.fromarray(env.render(mode="rgb_array")))

env.frames = []

with torch.no_grad():

env.rollout(

max_steps=max_steps,

policy=policy,

callback=rendering_callback,

auto_cast_to_device=True,

break_when_any_done=False,

)

env.frames[0].save(

f"{scenario_name}.gif",

save_all=True,

append_images=env.frames[1:],

duration=3,

loop=0,

)

from IPython.display import Image

Image(open(f"{scenario_name}.gif", "rb").read())

结论和后续步骤¶

在本教程中,我们看到了

如何在 TorchRL 中创建多智能体环境,它的规范如何工作,以及它如何与库集成;

如何在 TorchRL 中使用 GPU 矢量化环境;

如何在 TorchRL 中创建不同的多智能体网络架构(例如,使用参数共享、集中式评论员)

我们如何使用

tensordict.TensorDict来承载多智能体数据;如何将所有库组件(收集器、模块、回放缓冲区和损失)整合到多智能体 MAPPO/IPPO 训练循环中。

现在您已经精通多智能体 DDPG,您可以查看 GitHub 仓库中的所有 TorchRL 多智能体实现。这些是许多流行 MARL 算法的代码脚本,例如本教程中看到的算法、QMIX、MADDPG、IQL 等等!

您还可以查看我们关于如何在 PettingZoo/VMAS 中训练具有多个智能体组的竞争性 MADDPG/IDDPG 的多智能体教程:TorchRL 教程:竞争性多智能体强化学习 (DDPG)。

如果您有兴趣在 TorchRL 中创建或包装自己的多智能体环境,您可以查看专门的文档部分。

最后,您可以修改本教程的参数来尝试许多其他配置和场景,成为 MARL 大师。以下是一些 VMAS 中可用场景的视频。