注意

转到末尾 下载完整的示例代码。

ONNX 简介 || 将 PyTorch 模型导出为 ONNX || 扩展 ONNX 导出器算子支持 || 将包含控制流的模型导出为 ONNX

将 PyTorch 模型导出为 ONNX#

创建日期:2023 年 10 月 4 日 | 最后更新日期:2025 年 7 月 11 日 | 最后验证日期:2024 年 11 月 5 日

作者:Ti-Tai Wang, Justin Chu, Thiago Crepaldi。

注意

从 PyTorch 2.5 开始,有两种 ONNX 导出器选项可用。* torch.onnx.export(..., dynamo=True) 是推荐的导出器,它利用 torch.export 和 Torch FX 进行图捕获。* torch.onnx.export 是依赖已弃用的 TorchScript 的旧方法,不再推荐使用。

在 60 分钟速成班 中,我们有机会对 PyTorch 进行高层次的学习,并训练了一个小型神经网络来对图像进行分类。在本教程中,我们将在此基础上进一步介绍如何使用 torch.onnx.export(..., dynamo=True) ONNX 导出器将 PyTorch 定义的模型转换为 ONNX 格式。

虽然 PyTorch 在模型开发迭代方面表现出色,但模型可以以不同的格式部署到生产环境,包括 ONNX (Open Neural Network Exchange)!

ONNX 是一种灵活的开放标准格式,用于表示机器学习模型。标准化的机器学习表示允许它们在各种硬件平台和运行时环境中执行,从大规模云端超级计算机到资源受限的边缘设备,例如你的网页浏览器和手机。

在本教程中,我们将学习如何

安装必要的依赖项。

编写一个简单的图像分类器模型。

将模型导出为 ONNX 格式。

将 ONNX 模型保存到文件中。

使用 Netron 可视化 ONNX 模型图。

使用 ONNX Runtime 执行 ONNX 模型

比较 PyTorch 的结果与 ONNX Runtime 的结果。

1. 安装必要的依赖项#

由于 ONNX 导出器使用 onnx 和 onnxscript 将 PyTorch 算子转换为 ONNX 算子,因此我们需要安装它们。

pip install --upgrade onnx onnxscript

3. 将模型导出为 ONNX 格式#

现在我们已经定义了模型,我们需要实例化它并创建一个随机的 32x32 输入。接下来,我们可以将模型导出为 ONNX 格式。

torch_model = ImageClassifierModel()

# Create example inputs for exporting the model. The inputs should be a tuple of tensors.

example_inputs = (torch.randn(1, 1, 32, 32),)

onnx_program = torch.onnx.export(torch_model, example_inputs, dynamo=True)

[torch.onnx] Obtain model graph for `ImageClassifierModel([...]` with `torch.export.export(..., strict=False)`...

[torch.onnx] Obtain model graph for `ImageClassifierModel([...]` with `torch.export.export(..., strict=False)`... ✅

[torch.onnx] Run decomposition...

[torch.onnx] Run decomposition... ✅

[torch.onnx] Translate the graph into ONNX...

[torch.onnx] Translate the graph into ONNX... ✅

正如我们所见,模型无需任何代码更改。生成的 ONNX 模型存储在 torch.onnx.ONNXProgram 中,作为二进制 protobuf 文件。

4. 将 ONNX 模型保存到文件中#

尽管在许多应用程序中将导出的模型加载到内存中有用,但我们可以使用以下代码将其保存到磁盘:

onnx_program.save("image_classifier_model.onnx")

你可以使用以下代码将 ONNX 文件加载回内存并检查其是否格式正确:

import onnx

onnx_model = onnx.load("image_classifier_model.onnx")

onnx.checker.check_model(onnx_model)

5. 使用 Netron 可视化 ONNX 模型图#

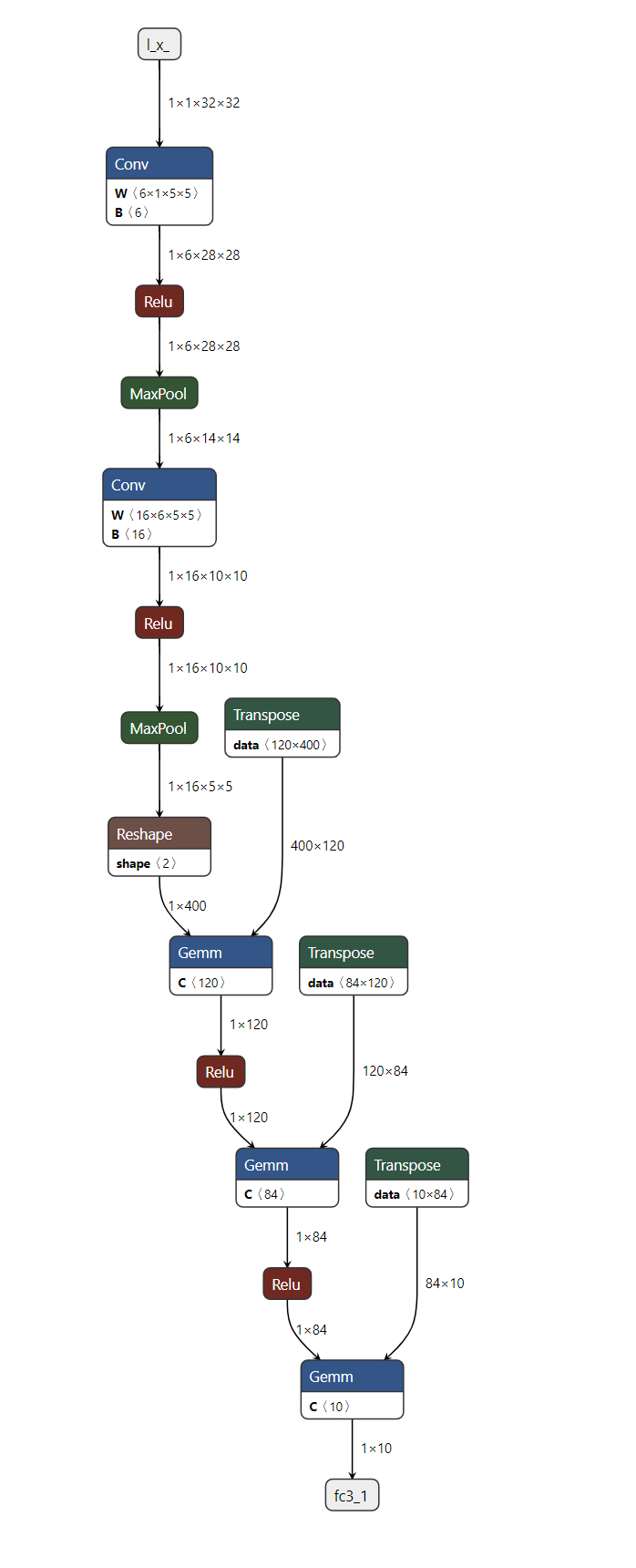

现在我们已经将模型保存到文件中,我们可以使用 Netron 可视化它。Netron 可以在 macos、Linux 或 Windows 计算机上安装,也可以直接从浏览器运行。让我们通过打开以下链接来尝试 Web 版本:https://netron.app/。

Netron 打开后,我们可以将 image_classifier_model.onnx 文件拖放到浏览器中,或者在点击“打开模型”按钮后选择它。

就是这样!我们已成功将 PyTorch 模型导出为 ONNX 格式,并使用 Netron 可视化了它。

6. 使用 ONNX Runtime 执行 ONNX 模型#

最后一步是使用 ONNX Runtime 执行 ONNX 模型,但在执行之前,我们先安装 ONNX Runtime。

pip install onnxruntime

ONNX 标准并不支持 PyTorch 中的所有数据结构和类型,因此我们需要在将 PyTorch 输入馈送到 ONNX Runtime 之前,将其适配为 ONNX 格式。在我们的示例中,输入恰好是相同的,但在更复杂的模型中,输入可能比原始 PyTorch 模型多。

ONNX Runtime 需要一个额外的步骤,包括将所有 PyTorch 张量转换为 Numpy(在 CPU 上),并将它们包装在一个字典中,其中键是输入名称的字符串,值为 Numpy 张量。

现在我们可以创建一个 *ONNX Runtime 推理会话*,使用处理后的输入执行 ONNX 模型并获取输出。在本教程中,ONNX Runtime 在 CPU 上执行,但也可以在 GPU 上执行。

import onnxruntime

onnx_inputs = [tensor.numpy(force=True) for tensor in example_inputs]

print(f"Input length: {len(onnx_inputs)}")

print(f"Sample input: {onnx_inputs}")

ort_session = onnxruntime.InferenceSession(

"./image_classifier_model.onnx", providers=["CPUExecutionProvider"]

)

onnxruntime_input = {input_arg.name: input_value for input_arg, input_value in zip(ort_session.get_inputs(), onnx_inputs)}

# ONNX Runtime returns a list of outputs

onnxruntime_outputs = ort_session.run(None, onnxruntime_input)[0]

Input length: 1

Sample input: [array([[[[-0.38049498, 0.609762 , 1.0972704 , ..., 0.7133924 ,

0.4941673 , 0.4716336 ],

[ 0.42390293, -0.05160836, -0.3051912 , ..., 0.780503 ,

-0.68477726, 0.46361122],

[-1.364354 , 0.24252038, -1.1595151 , ..., -1.1784661 ,

-0.7303728 , -0.14575301],

...,

[-0.54219604, 0.82248056, -0.3688359 , ..., -1.3733627 ,

0.62419015, 1.6706848 ],

[ 0.09802157, -0.36778256, -1.6492999 , ..., 0.87087506,

-0.41763693, 0.33648703],

[-0.8979219 , 2.0475664 , 0.1729193 , ..., 0.07267486,

-1.1652538 , 1.0624788 ]]]], dtype=float32)]

7. 比较 PyTorch 的结果与 ONNX Runtime 的结果#

确定导出模型是否良好的最佳方法是通过与 PyTorch 进行数值评估,PyTorch 是我们的真实来源。

为此,我们需要使用相同的输入执行 PyTorch 模型,并将结果与 ONNX Runtime 的结果进行比较。在比较结果之前,我们需要将 PyTorch 的输出转换为与 ONNX 的格式匹配。

torch_outputs = torch_model(*example_inputs)

assert len(torch_outputs) == len(onnxruntime_outputs)

for torch_output, onnxruntime_output in zip(torch_outputs, onnxruntime_outputs):

torch.testing.assert_close(torch_output, torch.tensor(onnxruntime_output))

print("PyTorch and ONNX Runtime output matched!")

print(f"Output length: {len(onnxruntime_outputs)}")

print(f"Sample output: {onnxruntime_outputs}")

PyTorch and ONNX Runtime output matched!

Output length: 1

Sample output: [[-0.04590763 0.04374031 0.01422022 0.04577638 0.097114 0.05399849

0.06685497 0.09272201 -0.05992632 -0.02955653]]

结论#

就这样!我们已成功将 PyTorch 模型导出为 ONNX 格式,将模型保存到磁盘,使用 Netron 查看了它,使用 ONNX Runtime 执行了它,最后将其数值结果与 PyTorch 的进行了比较。

延伸阅读#

下面的列表引用了从基本示例到高级场景的教程,不一定按列出的顺序。您可以随时跳转到您感兴趣的特定主题,或者坐下来,享受学习 ONNX 导出器所有知识的乐趣。

脚本总运行时间: (0 分钟 1.685 秒)