CELU#

- class torch.nn.modules.activation.CELU(alpha=1.0, inplace=False)[source]#

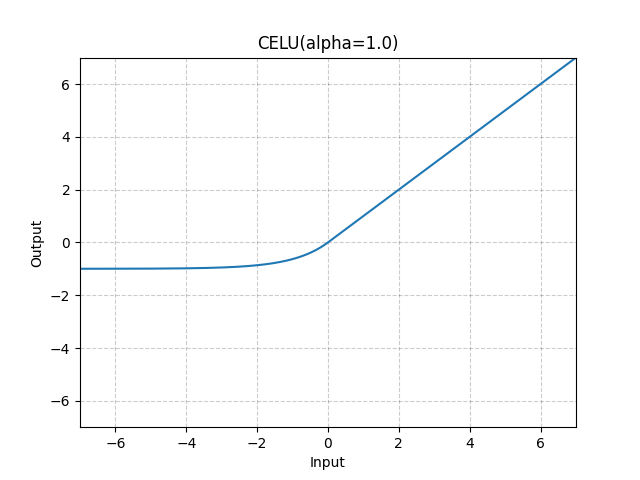

逐元素应用 CELU 函数。

更多细节可以在论文 Continuously Differentiable Exponential Linear Units 中找到。

- 形状

输入: ,其中 表示任意数量的维度。

输出: ,形状与输入相同。

示例

>>> m = nn.CELU() >>> input = torch.randn(2) >>> output = m(input)