ConstantLR#

- class torch.optim.lr_scheduler.ConstantLR(optimizer, factor=0.3333333333333333, total_iters=5, last_epoch=-1)[source]#

将每个参数组的学习率乘以一个小的常数因子。

乘法操作会一直进行,直到 epoch 数量达到预先定义的里程碑:total_iters。请注意,这种乘以小常数因子的操作可以与来自此调度器外部对学习率的其他更改同时发生。当 last_epoch=-1 时,将初始学习率设置为 lr。

- 参数

示例

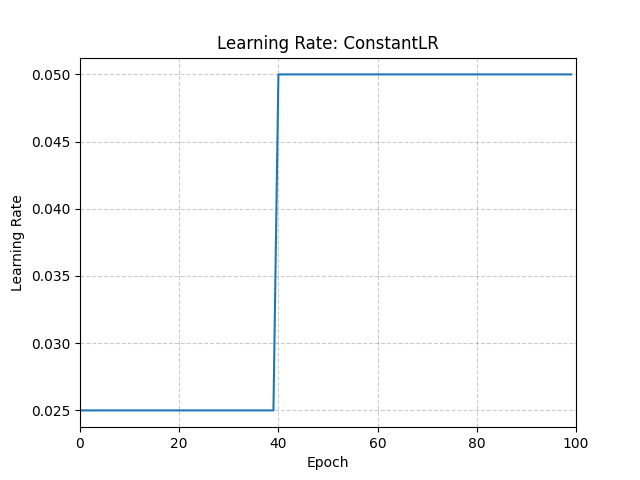

>>> # Assuming optimizer uses lr = 0.05 for all groups >>> # lr = 0.025 if epoch == 0 >>> # lr = 0.025 if epoch == 1 >>> # lr = 0.025 if epoch == 2 >>> # lr = 0.025 if epoch == 3 >>> # ... >>> # lr = 0.05 if epoch >= 40 >>> scheduler = ConstantLR(optimizer, factor=0.5, total_iters=40) >>> for epoch in range(100): >>> train(...) >>> validate(...) >>> scheduler.step()

- load_state_dict(state_dict)[source]#

加载调度器的状态。

- 参数

state_dict (dict) – 调度器状态。应为调用

state_dict()返回的对象。