ExponentialLR#

- class torch.optim.lr_scheduler.ExponentialLR(optimizer, gamma, last_epoch=-1)[source]#

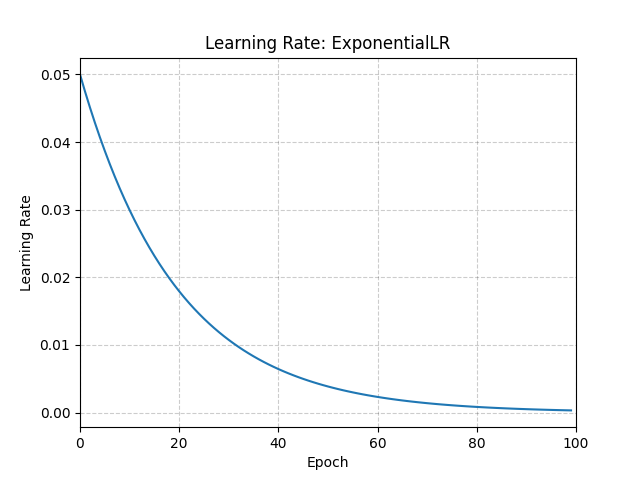

每轮(epoch)将每个参数组的学习率乘以 gamma 进行衰减。

当 last_epoch=-1 时,将初始学习率设置为 lr。

- 参数

示例

>>> scheduler = ExponentialLR(optimizer, gamma=0.95) >>> for epoch in range(100): >>> train(...) >>> validate(...) >>> scheduler.step()

- load_state_dict(state_dict)[source]#

加载调度器的状态。

- 参数

state_dict (dict) – 调度器状态。应该是对

state_dict()的一次调用返回的对象。